A l’occasion de la sortie du remake live-action du cultissime Ghost in the Shell de Mamoru Oshii, nous avons eu l’opportunité de passer un moment en compagnie de son réalisateur, Rupert Sanders et du superviseur VFX, Axel Bonami, du studio Moving Picture Company, à qui l’ont doit la majeure partie des effets spéciaux numériques du film.

Voici donc une plongée dans la mise à jour 2017 de cet univers cyberpunk initialement inspiré du célèbre manga de Masamune Shirow !

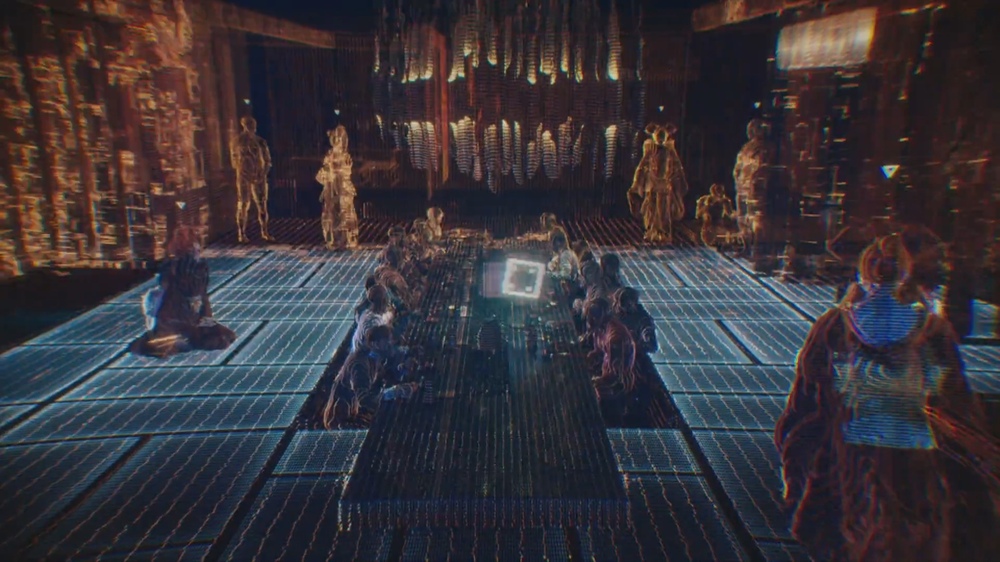

L'édition 1995 à gauche (revisitée avec des plans en CG depuis, mais on vous le découseille) et le nouveau de Rupers Sander à droite

Datant de 1989, l’œuvre de Shirow a considérablement inspiré la science-fiction contemporaine, réunissant de façons uniques de nombreux thèmes chers à la science-fiction orientée cyberpunk. Les fondements de l’oeuvre trouvent d’ailleurs aujourd’hui un écho sans précédent avec les récentes évolutions du monde : montée en puissance de nouvelles formes d’idéologies et d’extrémismes, fédéralisme et remise en question des frontières, politiques sécuritaires, espionnages massifs, BigData, etc. Ne se contentant pas de dépeindre un monde ultralibéral aux mains à des corporations oligarchiques mafieuses, l’univers de Ghost in the Shell rentre aussi en résonnance avec le discours aussi inquiétant qu’effrayants du transhumanisme.

Au-delà de cette dystopie futuriste, Shirow, Oshii et aujourd’hui Sanders, en profitant aussi pour poser de nombreuses questions d’ordre philosophique. Et au-delà de la forme, c’est sans doute ce qui fait la grande force de la licence et toute cette profondeur qui a séduit autant de monde. Cependant, les approches divergent. Si le manga originel est d’une complexité macro-politique rarement atteinte dans le genre, le film de Oshii se concentre davantage sur le personnage principal que sur l’écosystème. Au-delà de l’esthétisme, ce nouveau film quant à lui film cherche à préserver l’essence générale tout en se voulant plus accessible. Chaque vision apporte cependant son lot de questions d’avant-garde, toutes sujettes à mûres réflexions : quelle place pour l’intelligence artificielle dans la société ? Quelle place pour l’homme dans une société où le métabolisme et l'esprit peuvent être augmentés à loisir par la technologie ? Qu’est-ce que le vivant ? Que signifie être humain ? Où commence la conscience ? L’âme ? le Ghost ? Etc….

Autant de questions qui mériteront beaucoup de réflexions et des réponses dans les décennies à venir. En attendant, voilà de quoi vous plonger dans l’envers du décor de cette nouvelle adaptation avec une rencontre avec ses auteurs, le réalisateur Rupert Sanders et le superviseur VFX Axel Bonami du studio MPC.

|

|

viméo

>>> Continuez avec une interview en compagnie Axel Bonami, Superviseur VFX chez Moving Picture Company

Axel Bonami - VFX Supervisor – Moving Picture Company

Axel débuté en tant qu’assistant Flame puis compositeur-artiste chez Duran, en 2001, en France. En 2008, il prend l’Eurostar pour aller travailler chez MPC sur Le Monde de Narnia : Le Prince Caspian. Il s’agissait d’un projet très délicat pour l’époque. Il a ainsi été embauché en tant que mid-compositor, puis a progressivement grimpé les échelons jusqu’à devenir superviseur VFX. Quand on lui demande son bilan sur ces années d’expérience, il nous répond « Tout est possible, mais cela demande travail acharné et persévérance. Nous avons la chance d’être dans une industrie qui nous permet de travailler sur des projets si extraordinaires, avec tant d’artistes du monde entier ».

Voilà quelques questions en sa compagnie afin d'en savoir plus sur les principaux effets éalisés pour ce nouveau Ghost in the Shell 2017 réalisé par Ruper Sander.

3DVF - Le premier film de Ghost in the Shell sortie en 2995 est définitivement un film d’animation culte depuis. Quelle a été ta réaction en apprenant que tu allais travailler sur le remake ?

Axel Bonami : J’ai commencé à travailler sur le film à la fin mai 2016 et j’étais évidemment très enthousiaste ! Je savais que ce serait un projet complexe, mais j’avais confiance dans le fait que mon équipe saurait relever le défi. Guillaume Rocheron, Production VFX Supervisor sur le film, nous a guides et donné ses conseils. J’avais déjà eu l’occasion de travailler avec lui, notamment sur Godzilla.

3DVF - En 1995, Matrix n’était pas encore sortie, personne n’avait encore entendu parler de transhumanisme, l’industrie des VFX était loin d’être ce qu’elle est aujourd’hui. Quels étaient les impératifs à respecter sur ce projet ?

Axel Bonami : Comme toujours, les effets visuels sont au service de l’histoire et de la vision du réalisateur.

Effectivement, les effets que nous avons fabriqués et ajoutés au film n’auraient pas été possibles il y a encore quelques années, et nous devons nous adapter, continuer à faire avancer les limites techniques du photoréalisme pour proposer la meilleure expérience visuelle possible aux spectateurs. Notre travail reste d’émerveiller et divertir le public ; nous combinons différentes techniques de pointe pour y parvenir, et nous en créons sans cesse de nouvelles.

La ville était un gros défi en raison du travail phénoménal déjà mené sur des films futuristes comme Blade Runner ou Dark City, mais le réalisateur avait en tête une idée claire du résultat à obtenir, et notre travail était donc d’y parvenir.

3DVF - Justement en tant que studio VFX au service de la vision d’un réalisateur, comment s’est passée la relation avec lui pour parvenir à coller à ses attentes ?

Axel Bonami : La liberté dans le processus de postproduction et VFX consiste au fond à partager des idées, proposer des solutions. La vision du film reste dirigée par le réalisateur et l’équipe du film, mais il y a effectivement certains visuels qui évolueront au travers d’une collaboration étroite entre le réalisateur, le Production VFX Supervisor et le studio MPC.

3DVF - Justement, plus qu’un simple remake de film d’animation en live, il souhaitait revisiter l’histoire et l’univers. Comment s’est déroulée la préparation de ce projet de votre travail de postproduction ?

Axel Bonami : Quand arrive la postproduction, une grande partie du travail de préproduction a été finalisé. Cela inclut concept arts, set design, costumes. Ainsi, quand nous intervenons, une grande partie des visuels de l’univers sont déjà définis, et nous avons beaucoup de ressources sur lesquelles nous pouvons nous appuyer.

Certains gros effets comme les villes futuristes nécessitent beaucoup de temps et d’itérations pour arriver au résultat final ; c’est un processus très interactif avec le Production VFX Supervisor, mais aussi avec le réalisateur.

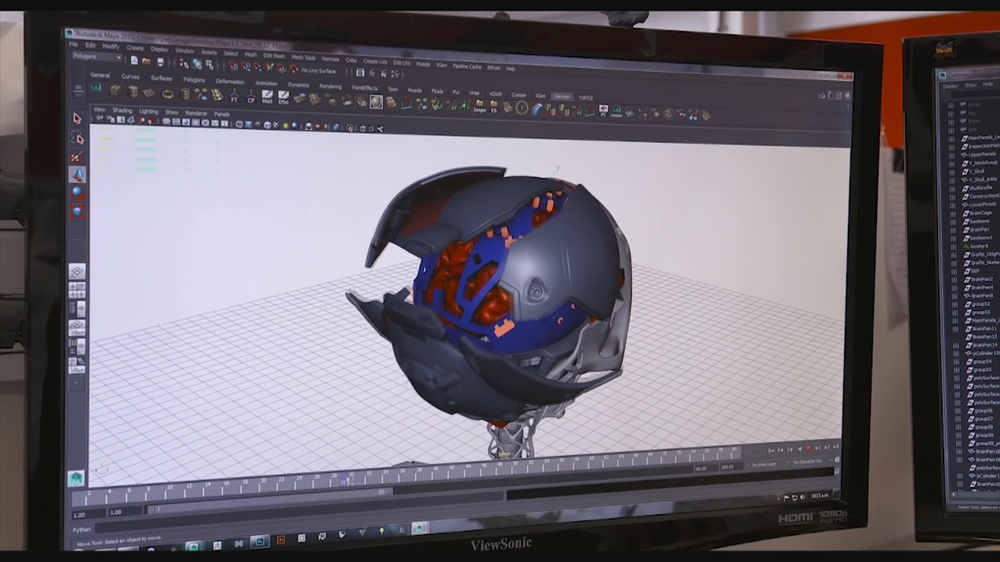

Nous obtenons l’approbation du réalisateur à travers plusieurs étapes de validation. Pour commencer, nous avions reçu des concept-arts du client, et l’équipe Concept Art de MPC Los Angeles a également beaucoup travaillé sur le film. Des concepts-sculpts ont aussi été créés par les designers. Nous présentons ensuite un modèle pour approbation, puis lançons un processus de texturing qui doit également être approuvé (à ce stade, ils peuvent être présentés sous forme de moodboards sujets à des discussions créatives). Les textures sont ensuite appliquées et le processus de look-dev débute véritablement, ce qui implique notamment des recherches sur les propriétés des matériaux utilisés, la mise en place du shading, etc..

Une fois qu’un asset est validé, je peux entamer mon travail sur un plan. Le processus de validation d’un plan varie parfois, mais cela passe généralement par l’approbation du layout, avec la mise en place des caméras et la composition globale du plan. Ensuite, il y a différentes étapes d’animation afin d’obtenir une validation primaire d’animation, en fonction de la complexité du plan. D’autres départements présentent également leur travail pour approbation, par exemple les environnements, les FX, etc. On obtient donc la bonne atmosphère. Tous ces éléments passent ensuite au travers du Lighting, et le plan final est présenté sous forme de compositing en Work In Progress, comprenant les différents éléments approuvés éclairés et assemblés de façon sommaire. Le travail se poursuit ensuite jusqu’à la version finale, avec prise en compte des retours reçus durant la progression.Cependant, tous les plans ne passent pas systématiquement par un processus complet de validation allant jusqu’au réalisateur : il s’agit souvent des plans clés. Les étapes intermédiaires sont prises en charge par le Production VFX Supervisor qui présente ensuite le travail dans son ensemble au réalisateur, mais à un stade déjà plus développé.

3DVF - Les outils de préviz et de préproduction ont désormais un rôle prépondérant dans un projet de ce type mêlant Live et VFX numériques photoréalistes. Comment s’est déroulée cette étape de la fabrication, sachant notamment que MPC dispose d’équipes interconnectées sur 3 continents?

Axel Bonami : Nous avons employé une approche relativement classique sur ce projet, et n’avons pas fait appel aux techniques de production virtuelles utilisé couramment chez MPC.

En revanche, nos studios de Londres, Bangalore et Montréal ont travaillé effectivement sur le projet. Différentes portions du process sont centralisées sur certaines antennes ; la combinaison de toutes ces ressources nous permet de gérer un nombre colossal de plans sur un projet de ce type, tout en respectant les délais impartis par la production. Tous les sites disposent d’un HUB en commun, qui constitue un support visuel pour tout ce qui est fait dans tous les départements. L’infrastructure s’accompagne d’outils de suivi de production et l’ensemble reste donc très transparent. Nous avions une synchronisation automatique sur certains éléments avec des données préétablies en fonction du type d’effets recherchés. De multiples équipes de coordinateurs sont ensuite associées au suivi et à la coordination des tâches précises selon les spécificités de certains sites. La supervision du projet centralise ensuite les données, et travaille sur les plans finaux qui sont présentés au client. Avec le décalage horaire, il se passait toujours quelque chose quelque part.

3DVF - Vous avez produit plus d’un millier de plans numérique et en parallèle, Weta Workshop a fabriqué des centaines d’éléments de décors. Comment s’est déroulé votre collaboration avec et notamment la digitalisation de certains assets ?

Axel Bonami : Le film a en partie été tourné à Wellington, et Weta a travaillé sur une partie du travail de concept/set/prop design. Ils n’étaient pas impliqués dans le processus de postproduction.

Le film bénéficie d’un set design très soignés, et les éléments de décors créés par Weta constituent vraiment ce qui se fait de mieux à l’heure actuelle. C’est toujours un plaisir d’utiliser des éléments réels en postproduction. Même si nous finissons souvent pas les remplacer par des éléments numériques, cela donne à l’équipe de très bonnes références et facilite le travail de fusion entre éléments réels et la 3D.

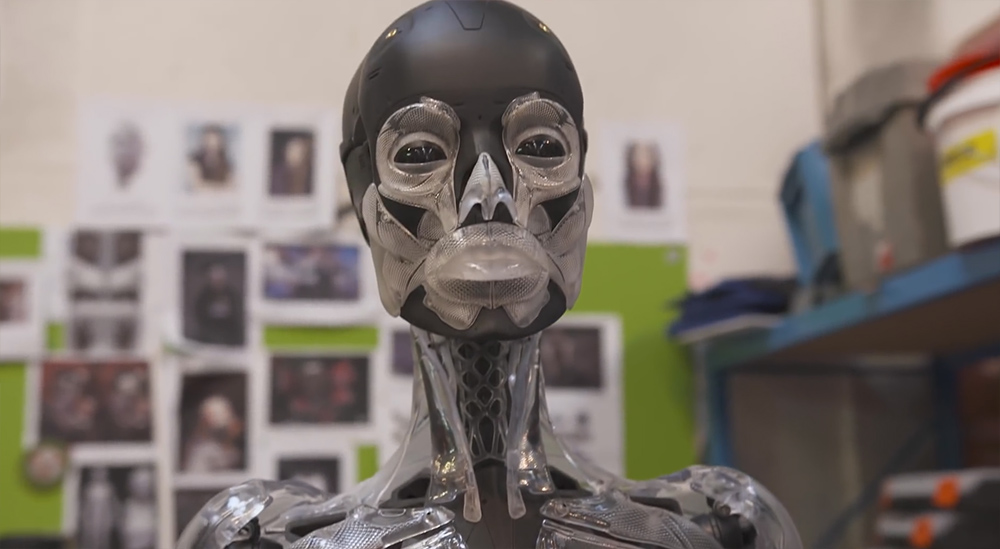

Par exemple, pour la Geisha, nous débutons la séquence avec un masque réel sur lequel nous avons rajouté quelques détails comme les paupières qui clignent, puis on bascule vers un rendu semi-réel en remplaçant la partie du visage qui s’ouvre et en projetant un câble de hacking qui révèle certaines parties internes ; ces détails sont justement ajoutés en numérique. Le rendu passe ensuite au full CG quand elle se brise, étend ses membres et grimpe au mur comme une araignée. Mais même à cette étape, certains éléments restent réels çà et là.

Cela signifie évidemment que l’on doit créer une version 3D qui sera totalement identique à la version réelle. Pour moi, mêler 3D et traditionnel constitue la meilleure recette pour créer l’illusion du réel. Le spectateur ne remet pas en question le résultat si la transition se fait sans bavure et que ça ne le détache pas de l’histoire.

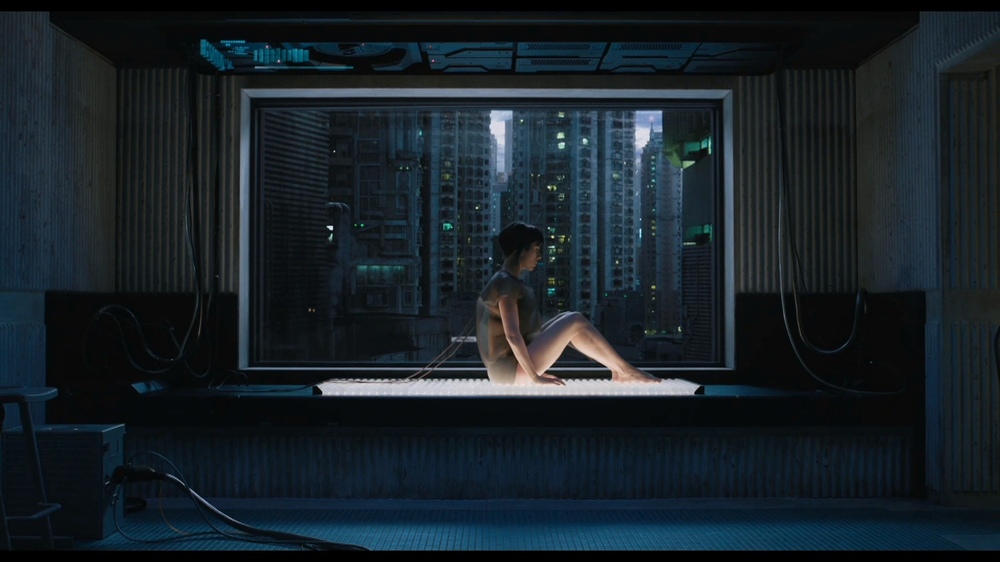

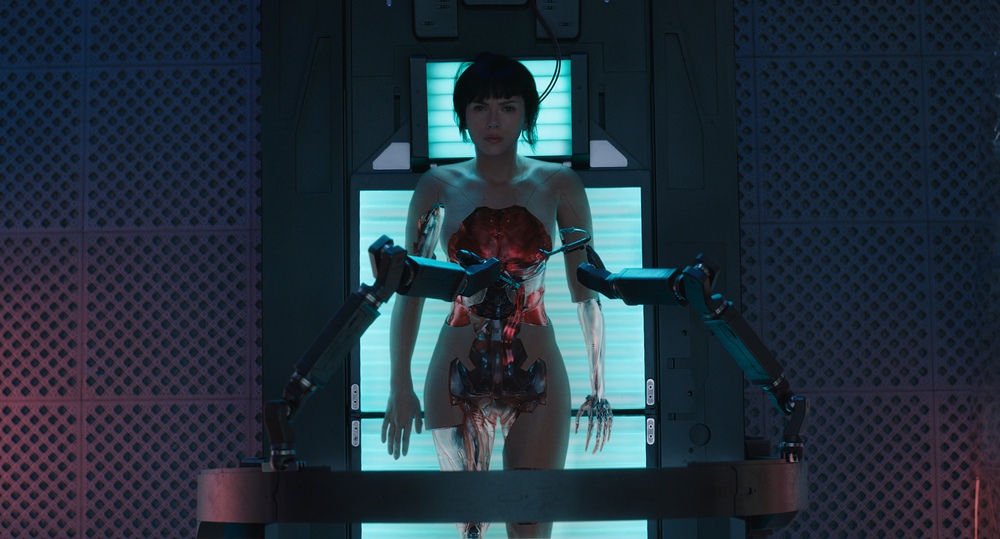

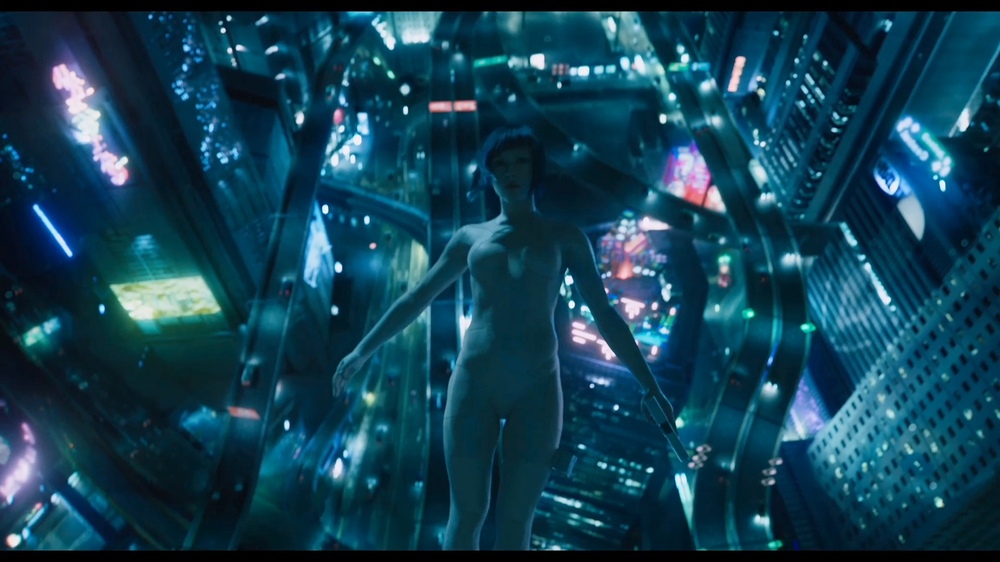

3DVF - Peux-tu nous en dire plus sur la réalisation de la célèbre ”shelling sequence” d’introduction du film original et revisité pour l’occasion ?

Axel Bonami : Nous avons entamé le travail à partir d’une prévisualisation assez précise sur le cadrage et le ton de la séquence. Nous avons également revu la séquence originale pour nous replonger dans son atmosphère, mais nous avons ensuite voulu nous en détacher de façon à ajouter une touche de nouveauté et de photoréalisme. Quasiment tous les plans de cette séquence comportent du live-action, filmé avec le squelette de Weta, l’enveloppe sortant du liquide blanc, le mannequin qui s’élève, puis Scarlett en combinaison pour les derniers plans. On avait donc une très bonne base pour mettre en place la séquence complète.

Nous avons recréé une version 3D du squelette, ses muscles, une surface en gel balistique et la version nue du personnage avec les contours des différentes pièces de surface. Nous avons utilisé ces assets dans beaucoup d’autres séquences, donc nous les avons modélisés, shadés et riggés de façon à pouvoir multiplier les usages possibles.

Tout ceci nous a permis d’avoir un meilleur contrôle créatif sur le cadrage, et tout particulièrement sur le shading. Toute la séquence devient une combinaison de 3D et d’éléments réels, avec également quelques plans en full 3D. Comme nous avions le contrôle de la flexibilité des muscles sur notre version 3D, nous avons utilisé les séquences full 3D pour générer des animations et poses plus complexes, ajuster la caméra et l’éclairage avec plus de précision : autant de choses impossibles à réaliser avec la maquette réelle, bien plus fragile.

Quand le cerveau est extrait de la boîte crânienne, le plan utilise une maquette physique et un environnement 3D avec des particules et un éclairage volumétrique. Dans un autre plan, le crâne physique a une enveloppe et un cerveau en 3D pour améliorer l’aspect organique de l’ensemble, agrémentés de légers mouvements sur cerveau. Les dendrites qui font circuler les données étaient une combinaison de tubes gérés en animation. Les départements Tech Anim et FX ont ajouté un léger effet de pouls le long de la surface. Ils permettent d’introduire l’idée d’un réseau de données numériques, qui se mêlent dans des formes hélicoïdales en se connectant. Quand le squelette entre dans la zone de liquide, nous nous sommes éloignés des images filmées et avons opté pour du full 3D afin d’ajuster la caméra et le premier effet de revêtement liquide sur le gel balistique. Nous avons employé Houdini pour créer un modèle autour du squelette tandis qu’il traverse le liquide rouge.

Le corps qui s’élève vers la surface blanche et rencontre son reflet est une image forte et iconique. Nous avons utilisé l’approche full 3D car nous voulions introduire davantage de diffusion dans l’enveloppe pour voir le squelette sous forme de silhouette dans sa coquille. Nous voulions aussi souligner la composition et l’animation du corps. Les plans filmés ont été utilisés comme références pour l’intention, le lighting et la réponse des matériaux. La palette de couleur dans cette séquence est elle aussi très symbolique. Elle est le résultat d’une collaboration étroite avec Rupert Sanders et Andrew Proctor, qui a ensuite été intégrée et recrée par l’équipe compositing de MPC, sous la supervision de Ruslan Borysov.

Le corps s’élevant du liquide blanc était une combinaison d’effets traditionnels, mais avec des améliorations de l’éclairage, et d’un mélange de réel et 3D avec le liquide en CG qui coule du corps, mais aussi quelques plans full CG.

L’effet de peeling représentait un effet délicat à réaliser : nous devions contrôler précisément la taille, la vitesse et l’étendue des particules pour obtenir la bonne composition au niveau du plan, et coller au montage. Nous avons employé une combinaison de Houdini et d’outils réalisés par notre équipe de Tech Anim, sous l’égide du CG superviseur Jérôme Escobar (ndr : Hey Jé !!!!!!!)

L’élévation du corps qui suit cette séquence a été gérée en full CG ; nous avions donc un contrôle total sur le lighting/shading. Nous avons employé une technique de face-tracking avec Nuke Optical flow pour intégrer le visage de Scarlett sur le modèle 3D.

3DVF – Vous avez aussi travaillé sur les nombreux effets des séquences de tournage en milieu urbain, mais aussi la recréation d’une ville numérique pour l’extension de décors. Peux-tu nous en dire plus sur cette partie de la production ?

Axel Bonami : La représentation de l’environnement est une combinaison de plans d’ensemble aériens, les cinq « ghost cams » qui étaient de très longs plans de survol au-dessus de différentes parties de la ville (1 minute par plan environ), et de plans au niveau des rues.

Cela a nécessité un énorme travail de création d’assets de bâtiments, de blocs d’appartements, de routes, de piliers, de rues avec les éléments de décors, ec… Tout s’est déroulé sous l’égide de notre Environment Supervisor Pier Lefebvre. Il a aussi fallu mettre en place des matte-paintings et de nombreux layout pour l’ajout des effets de solograms et d’hologrammes.

Ce fut sans doute l’effet visuel le plus difficile et le plus long à mettre en œuvre sur tout le projet : en une minute de plan aérien au-dessus de la ville, on couvre plusieurs kilomètres de distance et tout doit sembler actif et vivant !Durant l’étape de layout, nous avons mis en place les caméras, commencé à mettre en place le mélange de bâtiments anciens et plus récents. Comme ils étaient inspirés de vrais lieux à Hong-kong, nous avons pu nous lancer à partir de l’organisation d’une vraie ville. Le tournage à Hong-kong nous avait donné l’opportunité de photographier différentes zones de la ville sur la trajectoire de la Ghost Cam.

3DVF – Justement, peux-tu nous expliquer le concept de cette technique de ghost cam ?

Axel Bonami : Guillaume a travaillé en préproduction sur la planification sur site et sur la prévisualisation du trajet de la caméra. L’idée originale était d’avoir des plans filmés par drone, mais vu la distance à couvrir et la règlementation locale, ce n’était pas possible. On a donc envoyé notre équipe passer plusieurs nuits sur différents toits et appartements pour photographier un maximum de références possible.

Nous avons ensuite commencé à travailler à partir du vrai plan de la ville, ajouté des centaines d’assets. Une fois la caméra validée, la production VFX nous a aidés à mettre en place les principaux « sologrammes », tandis que nous travaillions à installer les centaines d’hologrammes destinés à habiller les rues, et à mettre en place le texturing, lighting et shading de notre ville.

Nous avons ensuite utilisé Alice, l’outil de simulation de foules propriétaire de MPC, pour peupler la ville de milliers de passants. Nous l’avons également adapté pour générer du trafic automobile au niveau du sol et sur les multiples niveaux d’autoroutes aériennes. Nous avons employé un processus similaire pour les autres plans d’ensemble.

Les plans au niveau du sol ont utilisé une combinaison de références live-action et de bâtiments 3D, d’ajouts en matte painting, une combinaison de sologram rendus et éclairés et d’hologrammes générés au compositing à l’aide de Nuke et RenderMan dans ce dernier cas, pour générer des passes d’interaction/réflexion.

Nous avions environ 400 éléments individuels de graphic design/hologrammes/sologrammes venus de studios multiples à ingérer, combiner et utiliser en layout pour créer notre ville numérique.

Les sologrammes sont une combinaison de vraies personnes et de designs graphiques publicitaires. Les personnes ont été filmées avec le rig de Digital Air, constitué de 80 caméras vidéo HD synchronisées. Nous avons ensuite utilisé un processus de photogrammétrie sur le clip de 400 frames générés, et il y a eu environ 60-70 assets traités de cette façon.

La photogrammétrie permet de générer un modèle 3D avec des textures bakées pour chaque frame ; nous avons ensuite lancé le calcul de voxelisation à l’aide de Houdini, pour convertir ces modèles en grilles de voxels 3D qui conservent les données de textures ; nous pouvions ensuite contrôler la densité, la taille et le comportement des voxels. Nous avons mis en place des conventions de nommage internes de façon à pouvoir associer la qualité des voxels avec le lieu du sologramme concerné, certains étant plus avancés technologiquement et en meilleure résolution, d’autres moins poussés, plus basiques et avec des bugs.

Enfin, nous avons combiné certains de ces sologrammes avec des logos et publicités conçus par le studio Territory, et placé le tout dans les plans.

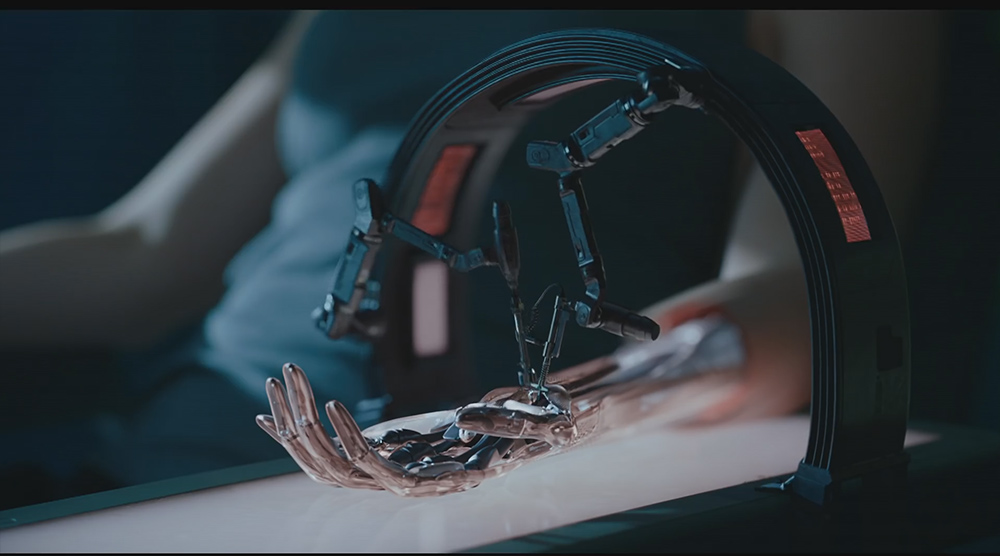

3DVF – Que peux-tu nous dire concernant les effets sur les personnages, et notamment les différents cyborgs ?

Axel Bonami : Nous avons plusieurs personnages hybrides dans le film. Le Major avait sa combinaise costume thermoptique, de même que deux séquences de reconstruction (corps entier dans l’une, bras dans l’autre),. Il y avait aussi les Geishas évoquées plus haut, et le personnage de Kuzé dont on peut voir à plusieurs reprises le squelette mécanique. Le travail sur les personnages suivait un processus similaire au reste : une étape de roto anim au cours de laquelle la doublure numérique est alignée sur le mouvement exact du véritable acteur, puis le département Tech Anim ajuste et améliore la précision. Cela nous donnait une version full 3D du personnage rendue avec la même lumière, qui matchait à la perfection à l’acteur réel. Nos versions 3D ont des muscles qui bougent, du jiggle/flex comme de vrais muscles, des simulations de cloth pour les mouvements de tissu, etc. Nous pouvions donc reproduire la réalité et fusionner quand il le faut les éléments réels avec notre travail en 3D.Pour Kuzé, nous avons tracké les subtilités des mouvements du visage du vrai acteur pour les recréer en 3D . Au final, son visage est donc un mix de 3D et de live action. Dans certains plans son bras gauche est réel, dans d’autres il est en 3D. Je ne vous dirai pas de quels plans il s’agit : si vous n’arrivez pas à faire la différence par vous-même, c’est que nous avons bien bossé !

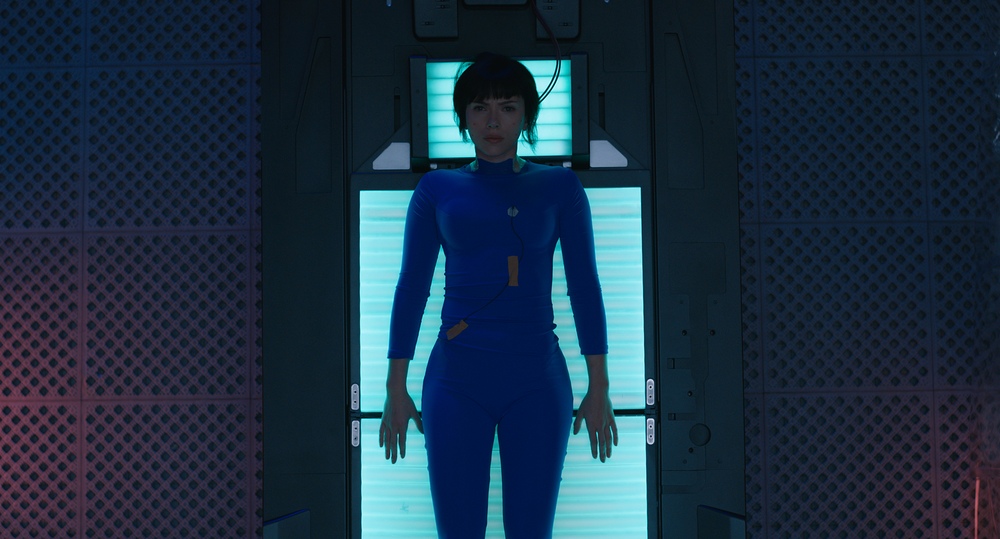

3DVF – Pour plaire aux fans et coller à l’original, il y aussi la fameuse combinaison Thermoptic du Majos et son effet d’invisibilité . Comment avez-vous abordé et réalisé cet effet ?

Axel Bonami : L’effet d’invisibilité était un autre gros défi. Même si des effets de cape d’invisibilité ont déjà été réalisés au cinéma, nous devions créer une nouvelle façon de visualiser ce concept. Nous avons en fait utilisé un langage graphique similaire pour le système d’invisibilité et les Sologrammes. La voxelisation nous a permis de générer une sorte de grille de voxels 3D composée de petits cubes/pixels, qui pouvaient être activés par proximité. Nous pouvions ainsi contrôler la taille, la durée de vie et nous pouvions générer des artefacts numériques autour du sujet. C’est comme si le Major générait autour d’elle un champ de pixels 3D qui peuvent ensuite avoir différentes réponses optiques : réflexion, réfraction, auto-occlusion, opacité…

Nous avons généré ensuite des maps pour les différents panneaux de la combinaison afin de pouvoir jouer sur différents niveaux d’artefacts. L’invisibilité devient ainsi la somme d’artefacts de réflexion, réfraction, opacité, transparence totale et compression colorimétrique, avec des maps de vélocité pour combiner le tout.

Pour les interactions, différentes méthodes ont été utilisées. Il y a des plans dans lesquels le Major est réellement dans le plan et nous l’avons rendue invisible, d’autres où elle n’y est pas et avons ajouté sa version invisible.

Pour la séquence du « Skinny Man » où le major se bat avec un homme dans l’eau et qu’elle le projette en l’air, notre équipe de RotoPrep l’a supprimée de l’image à l’aide de plans vierges, et on ensuite projetée la version numérique en faisant un travail de peinture numérique image par image. Cela nous a permis de conserver une partie des interactions avec l’eau, et nous avons pu faire de la rotoscopie sur la performance, puis faire un rendu des éléments numériques dont nous avions besoin pour obtenir l’effet d’invisibilité. Nous avons aussi utilisé des simulations d’eau classiques pour raccorder le tout.

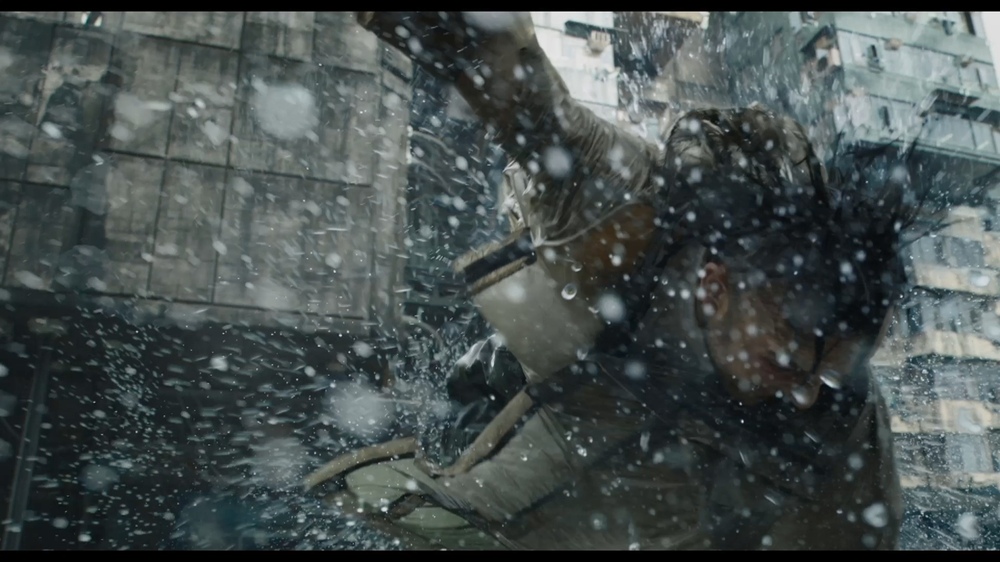

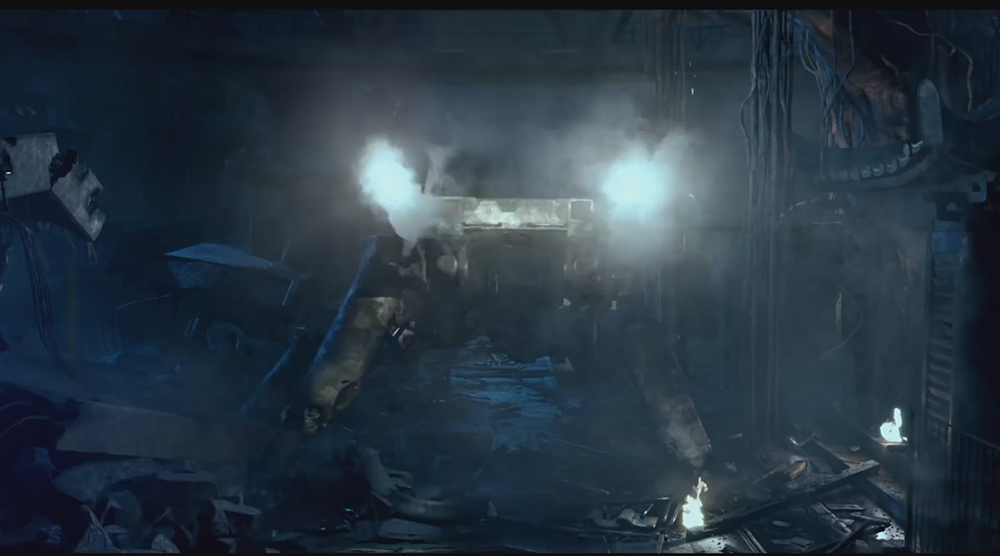

3DVF – La séquence du combat final avec le tank de combat est aussi l’un des moments forts du film de Oshii. Comment avez-vous travaillé sur sa réinterprétation ?

Axel Bonami : Le concept originel du tank a été construit par le studio Vitaly. Ce fut notre point de départ. Il y a eu quelques modifications en cours de chemin pour prendre en compte des besoins liés au storytelling et à l’animation, mais le résultat est resté très proche de l’original.

Le rigging est finalement assez simple et se base sur un rig en rigid body. Il y avait beaucoup de pistons et d’engrenages, et il fallait donc se concentrer la mise en place des contrôles dont l’équipe avait besoin, tout en respectant les contraintes des pièces mécaniques, afin que le résultat soit cohérent et ressemble à une vraie machine.Nous avons étudié le mouvement de nombreux objets et équipements massifs et lourds. Il a fallu faire den nombreux essais pour déterminer la façon dont le tank allait bouger ses pattes, sa tête et avoir du recul lors des tirs. Une fois que le personnage et le poids du tank ont pu être établis, il ne restait plus qu’à l’intégrer au plan.

L’environnement de la séquence s’inspire d’un vrai lieu existant à Hong-kong, la place circulaire existe réellement. Notre équipe a photographié tout ce dont nous avions besoin sur place pour reconstruire la scène 3D. Dans le film il s’agit d’une zone abandonnée. Notre équipe environnements a donc créés plusieurs blocs de bâtiments abandonnés, et notre équipe Techn Anim y a ajouté de la vie avec des câbles suspendus et des bâches en mouvement. La scène a été tournée à Wellington en recréant partiellement le décor, et l’équipe a ensuite ajouté des débris. Puis nous avons tout détruit avec la mitrailleuse calibre 50mm du tank et ses missiles !

La destruction a été l’aspect le plus simple et direct de la production : MPC a énormément d’expérience sur les effets de destruction et d’explosions. Nous avons employé Kali (notre outil interne primé aux Oscars scientifiques et Techniques) pour les plus gros plans d’explosion, mais aussi Houdini en complément, sous la supervision 3D de Damien Stumpf. Le résultat final combine des éléments réels à ces effets numériques créés pour améliorer l’aspect visuel : explosions secondaires, débris, fumée...

3DVF – Pour avoir une idée du travail qu’a demandé ce projet, aurais-tu quelques chiffres permettant de prendre un peu de recul ?

Axel Bonami : Nous avons culminé à 600 artistes environ pendant les derniers mois de la production, et nous avons sans doute atteint les 800 au total au temps fort du projet pendant plus de 12 mois.

Pour les données, le volume est de l’ordre de 1,2 petabyte (1 200 000Gb), ce n’est pas vraiment quelque chose qu’on peut stocker chez soi… Le premier plan de Ghost Cam dure 1 minute environ, et prendrait 15 ans à rendre sur une unique station de travail moderne ! En plus du travail humain technique et créatif, il faut aussi compter sur un peu de puissance de calcul.

Pour ce qui concerne MPC, nous avons finalisé près de 1000 plans répartis sur près de 80 minutes du film.3DVF – Pour toi, quel a été le principal défi sur ce film ?

Axel Bonami : En fait, les défis principaux sont toujours le délai et la difficulté de créer un univers visuel à la fois époustouflant et crédible, qui servent le scénario et la vision du réalisateur.

Nous y sommes parvenus en combinant notre meilleure équipe de talents, un solide soutien en production, et beaucoup de travail. Le meilleur souvenir, pour moi, a été de faire partie d’une très bonne équipe, d’avoir surmonté un processus créatif si complexe. J’espère que le résultat est bon !

3DVF – Merci Axel pour ce retour d’expérience ! Pour terminer un petit mot sur l’actualité du studio MPC à venir et les opportunités de rejoindre vos rangs pour les lecteurs de 3DVF qui seraient tentés par l’aventure ?

Axel Bonami : Nous avons de très gros projets de prévus, comme Le Roi Lion ou Blade Runner 2049, et nous cherchons en permanence de nouveaux talents pour tous nos départements. Il y a de grands films sur lesquels travailler, de grosses opportunités pour faire évoluer ses compétences et construire une vraie carrière. MPC vient juste de remporter l’Oscar des meilleurs effets visuels pour Le Livre de la Jungle, ce dont nous sommes très fiers, et nous allons continuer à repousser les limites des effets visuels. Mais cela n’est possible qu’avec l’aide d’un gros travail d’équipe de tous nos artistes et nos équipes de production !